要約

聴覚の問題は、通常、音響オージオメトリーを用いて診断されます。これは患者の聴覚閾値を空気および骨伝導で様々な周波数で測定します。音響オージオメトリーの結果は、通常、オージオロガーによって解釈され、オージオグラムの形式で視覚的に表現されます。

これにより、正確な聴力障害のタイプを特定し、適切な治療を行うことができます。

しかし、この分野の専門家の数が少ないため、適切な診断が大幅に遅れることがあります。

本研究では、音響オージオメトリーのデータ分類のためのニューラルネットワークソリューションを提案しています。

提案されたソリューションは、双方向長短期記憶(BiLSTM)アーキテクチャに基づき、正常な聴力、伝音性聴力損失、混合性聴力損失、および感音性聴力損失を表す4つのクラスにオージオメトリーの結果を分類することを目的としています。

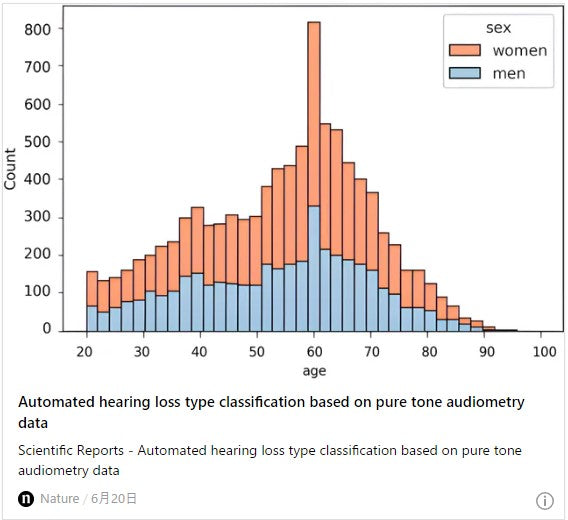

ネットワークは、15,046件のテスト結果を専門家のオージオロガーによって分析および分類されたデータで訓練されました。

提案されたモデルは、訓練外のデータセットで99.33%の分類精度を達成しています。

臨床応用では、このモデルにより一般医師は自身でオージオメトリーの結果を分類し、患者の紹介を行うことができます。

さらに、提案されたソリューションは、オージオロジストおよび耳鼻咽喉科医にAI決定支援システムへのアクセスを提供し、彼らの負担を軽減し、診断精度を向上させ、人為的なエラーを最小限に抑える潜在能力を持っています。

リンク先はscientific reportsというサイトの記事になります。(原文:英語)